[헬로티]

기술은 언제나 사람들을 따분한 일로부터 해방시켜주는 수단이었다. 예를 들면, 출근 시간 교통 정체에 갇히거나 주말에 몇 시간씩 꽉 막힌 고속도로를 운전하는 경우가 그렇다. 이는 자율 주행차(AV) 기술에 대한 기대감이 높아지는 이유다.

아툴리야 옐레페디(Atulya Yellepeddi) 연구 과학자

주목 받는 라이다 기술

다른 한 편에서는 2톤이나 되는 금속 덩어리가 사람도 태우지 않고 도로를 질주한다는 우려 때문에 안전한 주행을 보장하기 위한 기술들에 대한 관심도 고조되고 있다. 자율주행차에 고도의 안전성을 달성하기 위해서는 역동적으로 움직이는 물체(다른 차량, 보행자, 자전거 등)에 대해 상세한 3D 맵을 작성하는 것이 필요하다.

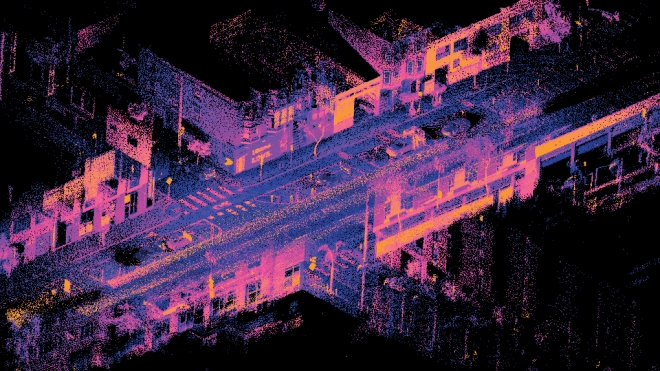

이러한 상세 지도 작성을 위해 자동차에서 주로 사용되는 기술 중의 하나가 LIDAR(light detection and ranging) 센서다. 그림 1은 이렇게 작성된 맵의 예시다.

▲LIDAR 맵

자율 주행차가 도로 상의 물체를 감지할 수 있는 거리가 멀면 멀수록 충돌을 회피하기가 수월하다. 아나로그디바이스의 기술 센터인 아나로그 거라지(Analog Garage)의 연구진은 어떻게 하면 LIDAR 시스템의 감지 거리를 늘릴 수 있을지 연구한 끝에 물체의 움직임에 대한 물리적 제약을 활용해 감지 거리를 늘리는 방법을 개발했다. 이 방법을 소개하기 전에, 먼저 LIDAR의 기본적인 작동 원리부터 살펴보기로 한다.

라이다의 작동 원리

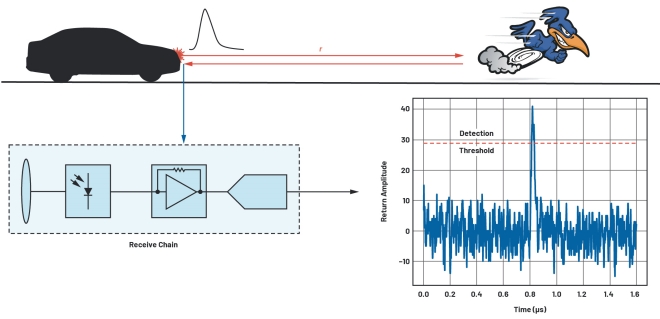

LIDAR 시스템은 물체에 레이저 펄스를 쏘아 이 빛이 물체에 반사돼 센서까지 돌아오는 시간을 측정하는 방법으로 동작한다. 그림 2는 이 원리를 설명하고 있다. 수평 및 수직 방향으로 레이저를 스캔해서 전방의 장면에 대한 전체 3D 맵을 형성한다.

▲LIDAR의 작동 원리

이 각각의 맵을 프레임이라고 한다. 최신 LIDAR 시스템은 통상 초당 10에서 30프레임(fps)의 프레임 레이트를 갖는다. 특정한 방향으로 레이저를 방출한 다음, 그 방향으로부터 들어오는 빛을 센서가 기록하고 이를 전기 신호로 변환한다.

그리고 정합 필터 기법을 사용해 신호로부터 레이저 펄스 형태의 위치를 탐색한다. 정합 필터의 출력을 임계값과 비교해서 이 임계값을 넘으면 감지를 선언한다.

감지 임계

하지만 현실 세계의 어느 것도 완벽하지는 않다. LIDAR의 감지 프로세스에는 잡음이 유입될 수 있다. 이것은 수신기의 다양한 소자들에서 발생하는 전기적 잡음일 수도 있고, 검출기 자체에서 나오는 광학적 잡음일 수도 있다.

따라서 물체로부터 충분한 빛이 반사되고 정합 필터가 신호를 잡음과 구분할 수 있어야만 물체를 감지할 수 있다. 물리 법칙에 따라서 빛의 세기는 빛이 출발한 지점에서부터 이동한 거리의 제곱으로 감소된다.

그러므로 200m 떨어진 거리에 있는 물체로부터 LIDAR 시스템으로 반사돼 되돌아오는 레이저 빛의 양은 100m 떨어진 거리에 있는 동일한 물체로부터 반사돼 되돌아오는 빛의 양의 1/4에 불과하다.

거리가 멀수록 정합 필터로 물체를 감지하기가 어렵고, 물체가 아주 멀리 떨어져 있으면 LIDAR 시스템에서 아예 감지되지 않을 것이다.

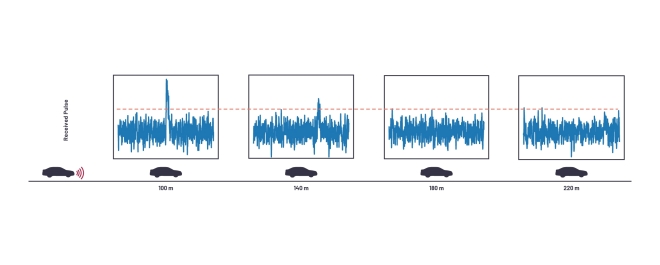

▲거리가 LIDAR 리턴 신호에 미치는 영향

그림 3은 이것을 보여줌으로써 거리에 따라서 리턴 신호 세기가 급격하게 감소하고, 220m 거리에서는 신호가 잡음과 거의 구분되지 않고 설정된 감지 임계에 잡히지 않는다는 것을 알 수 있다.

이 문제는 감지 임계를 매우 낮게 설정함으로써 피해갈 수 있다. 그러므로 그림 3에서 보이는 것처럼 220m 거리에서 차량을 식별할 수 있다. 하지만 SNR을 감안하면 잡음 또한 상당할 것이다.

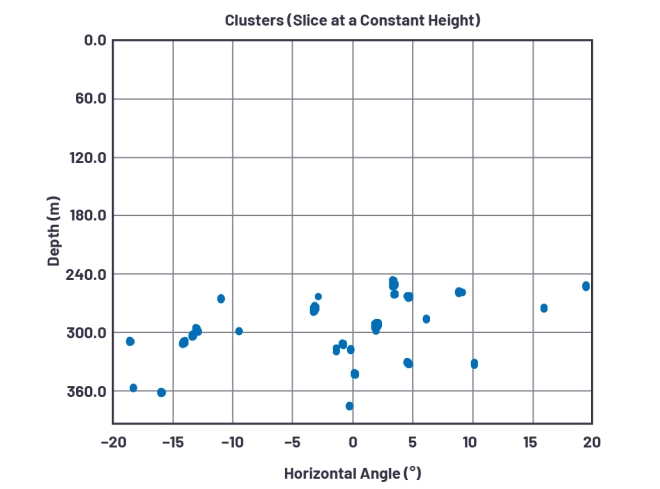

전체적인 3D 프레임에는 다수의 반짝임이 포함되는데, 어떤 것은 물체이고 어떤 것은 단지 잡음일 뿐이다. 그림 4는 LIDAR 프레임의 수직 슬라이스(고정된 수직 각도) 1개에 감지된 것들을 보여준다(임계값 적용 후). 감지된 것들 대부분이 잡음이지만 어떤 것은 실제 물체일 수 있다.

▲LIDAR 프레임의 단일 수직 슬라이스

그러면 어떤 것이 물체이고 어떤 것이 잡음인지 어떻게 구분할 수 있을까. 1개 프레임만 가지고는 이것을 구분하기 어렵지만, 몇 개의 프레임이 주어진다면 가능성은 더 높아진다.

반딧불이 추적 기법(firefly process)

왜 그런지 이해하기 위해서 하나의 예를 들어보자. 반딧불이가 상자 주변을 날고 있다고 가정해 보자. 반딧불이는 주기적으로 빛을 깜빡인다. 그런데 아쉽게도 우리는 주변 환경 때문에 임의로 깜빡이는 빛을 보게 될 때도 있으며, 이는 어디에서나 발생할 수 있다.

설상가상으로, 반딧불이가 반짝이는 불빛을 놓칠 수도 있으며, 우리가 반딧불이를 관찰하는 위치가 완벽하지 않을 수 있다.

우리가 하게 되는 근본적인 질문은 ‘그렇다면 각 프레임마다 1회씩의 깜빡임을 포함하는 장면들이 연속될 때, 그 연속 장면의 불빛들이 반딧불이에 의한 것인지 아닌지를 우리가 어떻게 알 수 있는가’다.

이 같은 질문을 기술적인 용어로 ‘가설 테스트’라고 한다. 이 때 우리가 결정해야 할 정보는 프레임 레이트가 초당 10프레임(10fps)이고, 당시 반딧불이는 물리적으로 합당한 방식으로만 움직일 수 있다는 것이다.

한 예로, 반딧불이는 한 프레임에서 상자 길이만큼 움직일 수는 없을 것이다. 그것은 물리적으로 비현실적인 속도이기 때문이다. 마찬가지로 2개 프레임에서 방향을 전환하는 것도 가능하지 않을 것이다. 이는 물리적으로 비현실적인 가속도이기 때문이다.

따라서 우리는 물리 법칙상 타당하다고 인정되는 반딧불이의 궤적에 한해서만 분석 대상으로 삼아야 한다. 궤적에 관한 이러한 제약 조건을 적용하면, 실제 반딧불이의 궤적과 잡음에 의해 만들어진 궤적을 구분할 수 있다.

가설 테스트는 어떠한 길이의 궤적이 주어졌을 때 우리가 제약 조건의 수학적 형태를 결정하고 적용할 수 있게 해준다. 2개, 3개의 연속 프레임에서 깜빡이는 불빛이 나타낼 경우, 제약 조건은 단지 궤적의 속도와 가속도에 대한 제한뿐이다. 궤적이 더 길 경우에는 제약 조건을 해석하기가 그리 간단하지는 않지만, 쉽게 적용할 수 있는 것으로 판명됐다.

결과

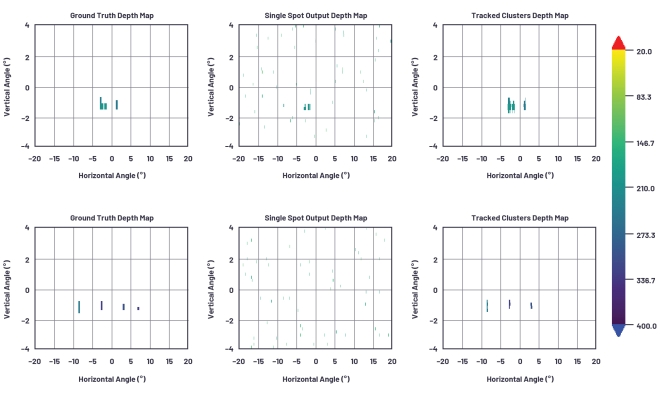

그림 5는 간단한 두 개의 장면으로 이 기법의 효과를 보여준다. 왼쪽 이미지는 프레임의 실제 맵을 보여줌으로써 도로 같은 물체를 단순화해 보여준다. 가운데 이미지는 기존의 처리 방식에 합리적인 임계를 적용해서 얻은 결과며, 오른쪽은 반딧불이 추적 기법을 적용했다.

▲반딧불이 추적 기법을 적용한 감지 사례

반딧불이 추적 기법으로는 거의 300m 떨어진 거리에서 물체를 감지할 수 있다. 최신 LIDAR 시스템은 감지 거리가 약 150m다. 표 1은 반딧불이 추적 기법을 적용했을 때와 기존 처리 방식을 적용했을 때의 감지율(%)과 오탐지(프레임 당) 비율을 나타낸 것이다(MF는 정합 필터를 뜻한다).

사전에 수집한 통계에 기반해 99.9% 신뢰도를 달성하도록 감지 임계를 설정했다. 특정한 피크는 물체에 해당한다. 하지만 감지율이 매우 낮다. 궤적 제약을 적용하면 개선에 약간 도움이 된다.

|

|

클러스터 크기 |

길이 |

감지율(%) |

오탐지 비율 |

|

반딧불이 추적 기법 |

|

3 4 5 6 7 8 9 10 |

67.7 65.6 61.5 58.8 55.1 51.6 46.9 40.6 |

3.14 0.12 0.04 0.02 0.03 0.02 0.00 0.00 |

|

MF 피크 99.9% |

1 10 20 50 |

|

19.1 18.0 13.1 6.7 |

52.00 14.34 0.00 0.00 |

▲표 1. 실험 결과

맺음말

반딧불이 추적 기법은 물체가 움직일 수 있는 방식의 한계를 기술한다. 다시 말해, 검출기나 신호 체인에 대해서가 아니라 측정하고자 하는 물체에 대한 제약을 기술하는 것이다.

이 기법은 기존의 감지 및 신호 체인의 문제점을 극복하고, 감지율을 크게 향상시킬 수 있는 잠재력이 있다. 이로부터 얻어진 통찰을 활용해 앞으로 더 지능적이고 정교한 신호 체인을 설계할 수 있을 것으로 보인다.

(이 글을 작성하는 데 도움을 준 제니퍼 탕(Jennifer Tang), 세파 데미르타스(Sefa Demirtas), 크리스토퍼 바버((Christopher Barber), 마일스 베네트(Miles Bennett)에게 감사드린다.)

참고문헌

Tang, Jennifer, Atulya Yellepeddi, Sefa Demirtas, and Christopher Barber. “Tracking to Improve Detection Quality in LIDAR for Autonomous Driving.” IEEE International Conference on Acoustics, Speech, and Signal Processing (ICASSP). May 2020.